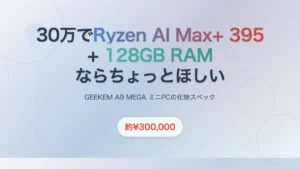

30万のAI PC、Ryzen AI Max+ 395をせっかく購入したので、ローカルで色々やらせようとしている。

基本的にLLM目当てではあったけれど、どうせなら色々……と思ってwhisper.cppもやらせてみた。めっちゃ疲れた。

Macだと割とサクッと環境構築できるのだが、Windowsはなんだか色々としんどい。とりあえずLLMにはものすごく振り回された。どや顔で手順1〜10まで出して完璧ですみたいな感じ出してきて、やってみると手順1でエラー出ると何か良くないものが芽生える。

あれこれやってとりあえず出来たのだが、まとめる気力もなかったので環境構築記事はAIに書かせた。環境構築手順が見たい人はこれらの記事を見て。

- M2 Pro Mac miniでWhisper.cpp(large-v3)をMetal対応で動かして文字起こしする手順

- Windows + MSYS2/MinGW + Vulkan で whisper.cpp を使う

チャット内では色々な手順を試してAIも大混乱しているのか、書かせた記事は滅茶苦茶だったが、一通り修正した……はず。なので手はだいぶ入っているがAI記事なので別館行き。一度構築した環境は二度構築することは多々あるので、メモは残すに限る。

最近はこの程度のメモ記事はAI記事にしているため、本館と別館に情報が散らばってしまい、正直後で見返す時に「どっちに書いたんだっけ?」ってなることが多い。またAI記事別館のほうが既に本館の数倍アクセスがあって、色々と思うところがある。実際今回も手順はAI別館のほうに投げているが、そちらのほうが一般的には参考にされるのかもしれない。まぁ、もうどうでもいいけど。

そんならこの記事は何を書くのかというと、まぁやってみましたということの思い出と、苦労したという報告と、AI記事のほうがアクセスあるってなんやねんっていう愚痴と、そしてM2 Pro Mac mini vs Ryzen AI Max+ 395でwhisper.cppやったメモである。

長い前置きをしておいて、結果だけしれっと書くと以下。これは13分くらいの音声について、large-v3で文字書き起こしをした時のもの。

| デバイス | threads | GPU | |

|---|---|---|---|

| M2 Pro Mac mini | 4 | METAL | 113秒 |

| M2 Pro Mac mini | 8 | METAL | 113秒 |

| GMKtec EVO-X2 | 4 | Vulkan | 123秒 |

| GMKtec EVO-X2 | 8 | Vulkan | 121秒 |

ということでM2 Pro Mac mini(12CPU, 19GPU)のほうが早かった。なるほどという感じではある。

まぁこれはそうかもなとは思っていた。元々圧倒的な128GBというユニファイドメモリなら、オフロードすることで70Bとか120BのLLMも使える、というそれだけのために買ったものだし、また実際、優位性はそれくらいだと思う。

とはいえMacで同容量のメモリを用意すると平然と倍くらいかかる。現在EVO-X2はAIサーバとしてメインの用途とは切り離した運用をしているが、さすがにこの価格差になると、次ばかりは本当に脱Macになるかもしれない。

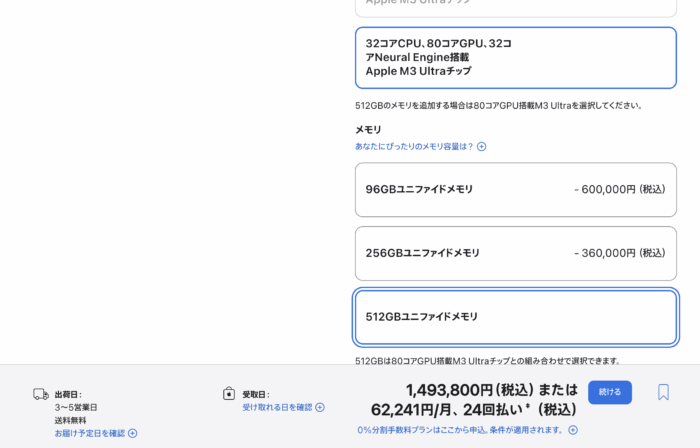

正直120Bだと、できるタスクは確かに広がるのだけれど、やっぱり「うん……まぁ……」という感じなので、671Bは最低限必要な気もする。メモリどんくらいいるんだろうね。512GBでギリいけるのかしら。

現状でも普通の人が買えるものとしてRAM512GBはギリギリなくはなく、Mac Studioで512GB積めるは積めるが、150万円からで震える。

しかし今まで買ったPCや周辺機器の合計するととんでもないことになりそうだなと思ったところで、考えるのをやめた。以上。

コメント